| Domäne | Ziele | Beispiele |

|---|---|---|

| Gebäudeautomation | Energie- & CO₂-Kosten senken, Komfortband einhalten | HVAC-Fahrpläne, Spitzenlastglättung |

| Energie & Smart Grid | Last verschieben, Speicher steuern | PV-Speicher-Dispatch, Tarifanpassung |

| Robotik | Geschickte Bewegungen | Greifen, Navigieren, Drohnenflug |

| Industrie 4.0 | Durchsatz erhöhen, Ausschuss reduzieren | Dynamische Taktung von Fertigungsstraßen |

| Games & Simulation | Strategiefindung | AlphaGo, komplexe 3-D-Spiele |

| Ansatz | Idee | Vor- und Nachteile |

|---|---|---|

| High-Fidelity Digital Twin | Ein vollständiges Simulationsmodell des Gebäudes (z. B. EnergyPlus), das bis hin zu Wandaufbauten, Fensterglas, Belegung und Wetter exakte thermische Antworten liefert. RL sammelt seine Millionen Schritte in der Simulation. | + Physikalisch fundiert + Keine Live-Risiken – BIM-Erstellung & Kalibrierung aufwendig – Rechenlast für lange Rollouts |

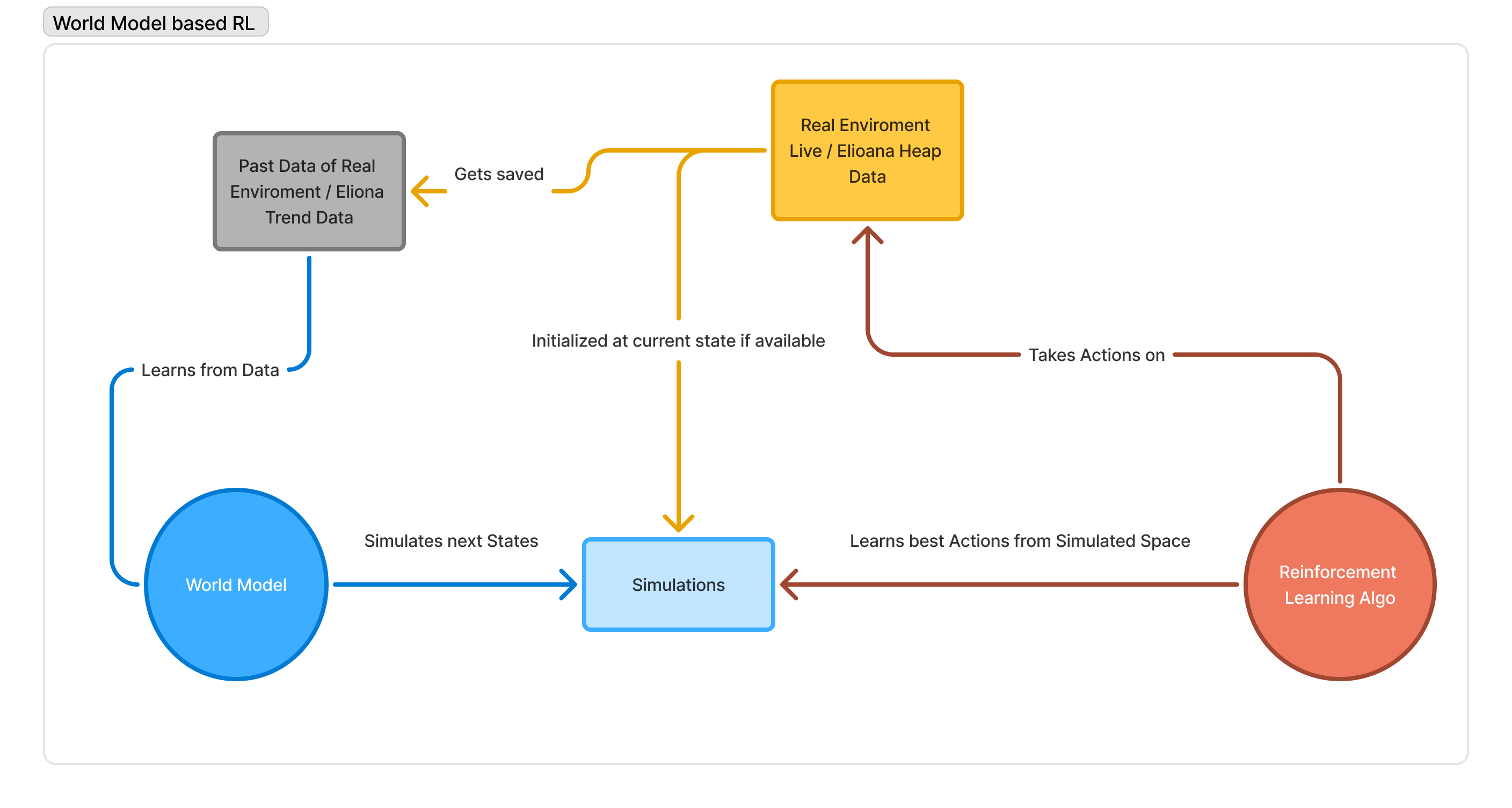

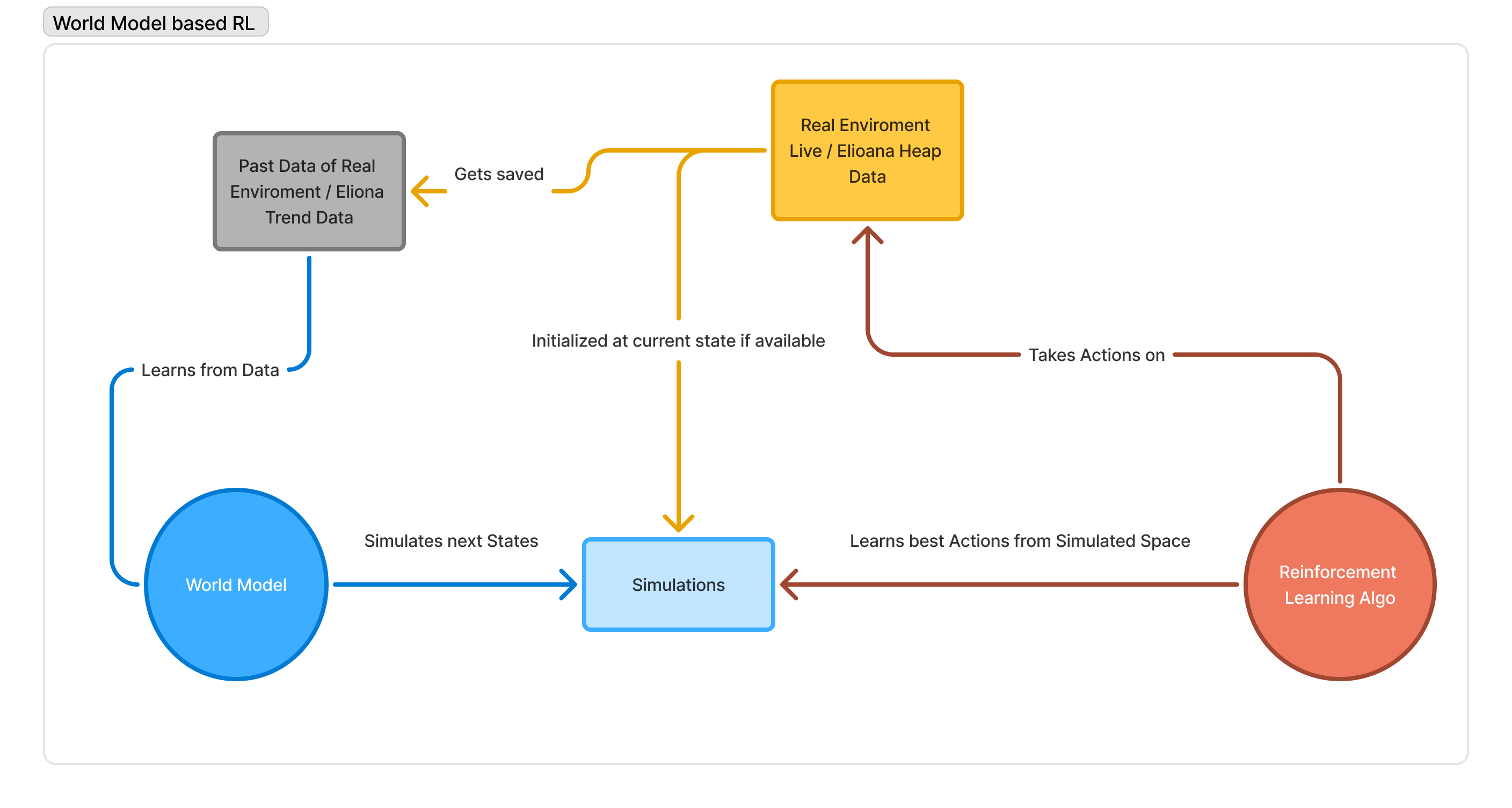

| Model-based RL / Weltmodelle | Statt schwerer Physik nutzt man ein lernbasiertes Weltmodell, das aus den 100 000 Log-Samples eine differenzierbare Mini-Welt extrahiert. Darin kann der Agent Millionen „geträumte“ Schritte pro GPU-Minute erleben. | + Extrem dateneffizient (oft < 10 000 reale Schritte bis Nutzen) + Sofort einsatzbereit wenn auf daten vor trainiert |

| Offline RL & Imitationslernen | RL lernt ausschließlich aus den vorhandenen Logs (BCQ, CQL …) also lernt diese erst zu Imitieren und von da aus zu verbessern, überschreibt die Politik aber nie mit Aktionen, die nicht im Datenspeicher vorkommen. | + Kein Twin nötig + Sofort einsatzbereit – Qualität hängt direkt an Log-Diversität |